基礎知識

LLM(大規模言語モデル)とは?生成AIやChatGPTとの違い、仕組み・活用例まで

LLM(大規模言語モデル)は、ChatGPTをはじめとする生成AIサービスの中核を支える技術であり、ビジネスの現場でも急速に活用が広がっています。

しかし、「LLMとは何か」「どんな仕組みで動いているのか」「自社の業務にどう活かせるのか」を正確に理解している方はまだ多くないのが実情です。

本記事では、LLMの基本的な定義から、生成AI・ChatGPTとの違い、仕組み・種類・活用事例・課題と対策まで、ビジネス担当者にもわかりやすく体系的に解説します。LLM導入を検討している方から、基礎から学び直したい方まで、ぜひ参考にしてください。

LLM(大規模言語モデル)とは

LLM(大規模言語モデル)とは、膨大なテキストデータを学習し、人間が使う言葉を理解・生成することに特化した人工知能技術の一種です。正式名称は「Large Language Models」の頭文字をとったもので、大規模言語モデルとも呼ばれます。従来の言語処理技術と一線を画すのは、学習データ量・計算量・パラメータ数(モデルの複雑さを示す変数の数)という3つの要素を桁違いに大規模化した点にあります。この大規模化によって、文章の翻訳・要約・質問応答・コード生成など、多様なタスクを高い精度でこなせるようになりました。

LLMが急速に普及した背景には、2017年にGoogleの研究チームが発表した論文「Attention Is All You Need」で提唱されたTransformer(トランスフォーマー)アーキテクチャの登場があります。このアーキテクチャが現代のLLMの基盤となり、その後のGPT・BERT・Geminiといった主要モデルの発展を支えました。

- そもそも言語モデルとは

- ファインチューニングとは

そもそも言語モデルとは

言語モデルとは、文章中の次の単語を確率的に予測する仕組みを指します。スマートフォンの文字入力で「今日は」と打つと「いい天気ですね」などの候補が表示される予測変換機能が、その身近な例です。言語モデルはこれと同じ原理で、大量のテキストデータから「ある単語の後にどの単語が来やすいか」を学習しています。

LLMが「大規模」と呼ばれる理由は、この学習に使うデータ量とモデルの複雑さが従来とは比較にならないほど大きいためです。たとえば、GPT-3は約1,750億個のパラメータを持ち、インターネット上の膨大なテキストを学習しています。パラメータ数が増えるほどモデルは複雑な言語パターンを捉えられるようになり、文脈を踏まえた自然な文章生成が可能になります。単語を一つひとつ予測するという基本原理は変わらないまま、その精度と応用範囲が飛躍的に広がったのがLLMの本質です。

ファインチューニングとは

ファインチューニングとは、汎用的な知識を持つ事前学習済みのLLMを、特定の業務や分野に合わせて追加学習させる手法です。「汎用→専門特化」のイメージで、医療・法律・カスタマーサポートなど、特定領域での精度を高めるために活用されます。

事前学習では膨大なデータを使って言語の基礎的な理解を獲得し、ファインチューニングでは比較的少量の専門データを追加することで、そのドメインに特化した応答ができるようになります。IPA(情報処理推進機構)の「テキスト生成AI 導入・運用ガイドライン」(2024年)でも、ファインチューニングは「特定分野に特化して回答精度を向上させられる」技術として位置づけられています。なお、外部データベースを参照して回答精度を高めるRAG(検索拡張生成)という手法もあり、ファインチューニングと組み合わせて使われることも多くなっています。

出典:IPA(情報処理推進機構)の「テキスト生成AI 導入・運用ガイドライン」(2024年)

日本企業のための

最も実用的なAIエージェントへ!

AIが企業の様々な職種の

方々が

普段行っている

タスクを自律的に実行

JAPAN AI AGENT

実用性の高いAIエージェンを提供

無料の伴走サポート

高いカスタマイズ性

目標設定をだけで自律的にAIが各タスクを実行

LLM(大規模言語モデル)と生成AI・ChatGPTとの違い

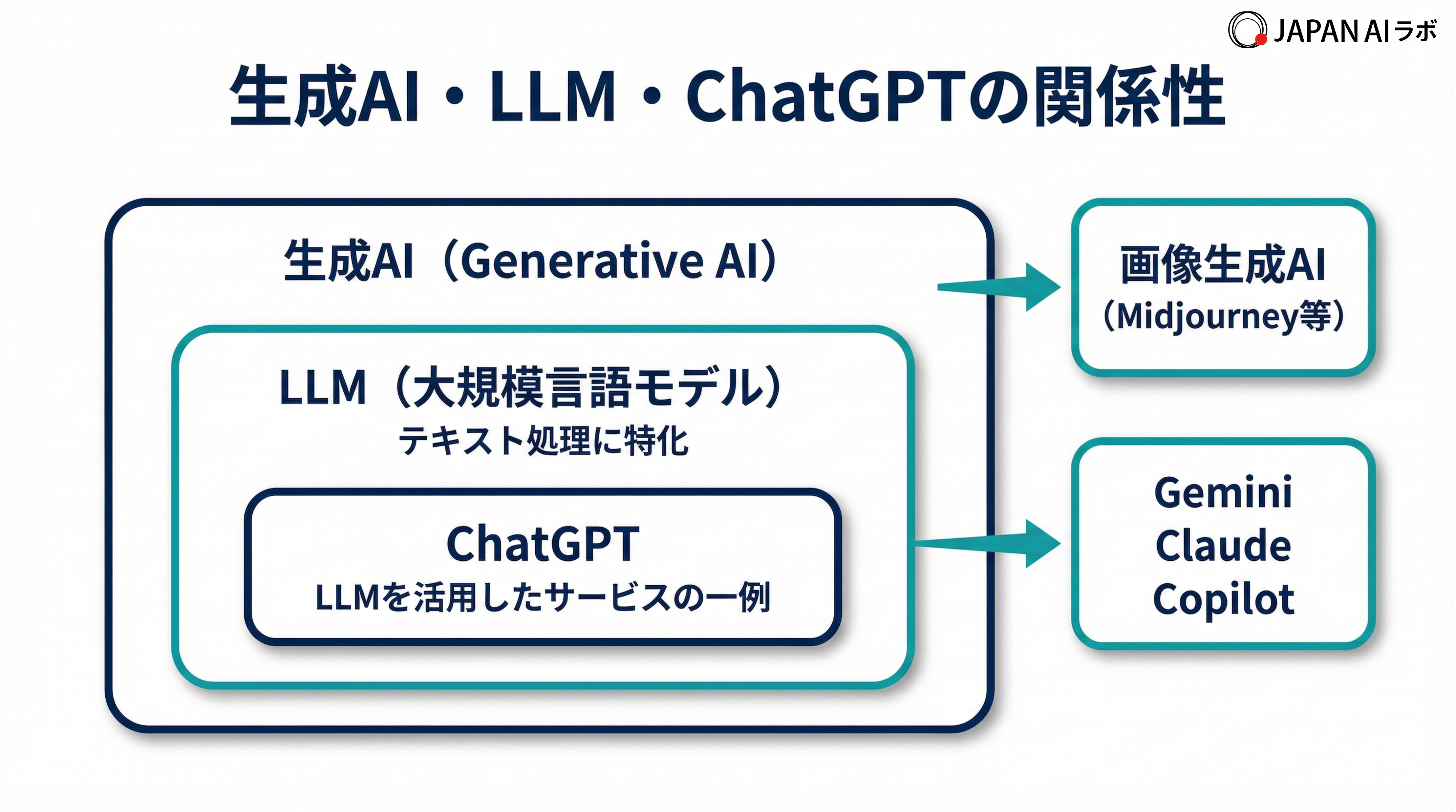

LLMと生成AI・ChatGPTの違いを一言で表すなら、生成AIが最も広い概念であり、LLMはその中でテキスト処理に特化した技術、ChatGPTはLLMを活用して作られたサービスです。「技術」と「製品」の違いと捉えると整理しやすいでしょう。

LLMと生成AI・ChatGPTは混同されやすいですが、それぞれの関係性を整理すると理解が深まります。生成AIとの違い、ChatGPTとの違いをそれぞれ詳しく解説します。

- 生成AIとの違い

- ChatGPTとの違い

生成AIとの違い

生成AIとは、テキスト・画像・音声・動画など、さまざまな種類のコンテンツを新たに生成できるAI技術の総称です。LLMはその中でも「テキストの理解と生成」に特化した技術であり、生成AIの一部に位置づけられる点で違いがあります。

生成AIには、画像を生成する拡散モデル(Stable Diffusionなど)や、音楽を生成するモデルも含まれます。一方、LLMはTransformer(トランスフォーマー)アーキテクチャを基盤とし、自然言語処理(NLP)に特化している点が特徴です。生成AIとLLMの違いを表にまとめると以下のとおりです。

| 項目 | 生成AI | LLM(大規模言語モデル) |

|---|---|---|

| 対象 | テキスト・画像・音声・動画など | テキスト(自然言語) |

| 代表例 | Stable Diffusion、Sora、MusicGen | GPT-4o、Gemini、Claude |

| 基盤技術 | 拡散モデル・GAN・Transformerなど多様 | 主にTransformerアーキテクチャ |

| 関係性 | LLMを包含する上位概念 | 生成AIのサブセット |

生成AIの詳細については、生成AIとは?従来のAIとの違いやできることなどわかりやすく解説もあわせてご参照ください。

ChatGPTとの違い

ChatGPTとLLMの関係は、「エンジン」と「車種」の関係に例えられます。LLMがエンジン(技術)であり、ChatGPTはそのエンジンを搭載した特定の車種(サービス)です。ChatGPTはOpenAIが開発したGPTシリーズのLLMを基盤として構築された対話型AIサービスであり、LLMそのものではありません。

同様に、GoogleのGeminiはGeminiシリーズのLLMを、AnthropicのClaudeはClaudeシリーズのLLMをそれぞれ基盤としています。つまり、LLMは複数存在し、それぞれを活用したサービスも多数展開されています。「ChatGPT=LLM」という理解は誤りであり、ChatGPTはLLMを活用したサービスの代表例の一つに過ぎません。

| サービス名 | 基盤LLM | 開発元 |

|---|---|---|

| ChatGPT | GPT-4oなど | OpenAI |

| Gemini | Gemini 2.0など | |

| Claude | Claude 3.7など | Anthropic |

| Copilot | GPT-4oなど | Microsoft |

LLM(大規模言語モデル)の仕組み

LLMの仕組みは、テキストの入力から出力までを5つのステップで処理します。各ステップを順に理解することで、なぜLLMが自然な文章を生成できるのかの仕組みが理解できます。現代のLLMはほぼすべてTransformer(トランスフォーマー)アーキテクチャ

を基盤としており、このアーキテクチャが高精度な文脈理解を可能にしています。 LLMが文章を処理する最初のステップは、入力されたテキストをトークンと呼ばれる最小単位に分割することです。コンピュータは文字をそのままの形では理解できないため、まず文章を処理しやすい単位に分解する必要があります。 たとえば、「AIを活用する」という文章は、「AI」「を」「活用」「する」のように分割されます。日本語の場合は単語・文節・文字など、言語の特性に応じた分割方法が採用されます。このトークン化の精度が、後続の処理全体の品質に影響するため、LLMの前処理として非常に重要な工程です。 トークン化された各単語は、次に数値の配列(ベクトル)に変換されます。これをベクトル化と呼びます。コンピュータは数値しか扱えないため、言葉の意味を数値として表現する必要があるためです。 ベクトル化の特徴は、意味が近い言葉ほど数値空間上でも近い位置に配置される点にあります。たとえば「猫」と「犬」は意味的に近いため、ベクトル空間上でも近い位置に配置されます。一方、「猫」と「自動車」は意味的に遠いため、ベクトル空間上でも離れた位置に配置されます。この仕組みによって、LLMは言葉の意味的な関係性を数値として扱えるようになります。 ベクトル化されたデータは、ニューラルネットワーク(人間の脳の神経回路を模した多層構造のモデル)で処理されます。現代のLLMが採用するTransformerアーキテクチャの核心は「セルフアテンション機構」にあります。これは、文章中のどの単語がどの単語と強く関連しているかを自動的に判断し、重み付けする仕組みです。 たとえば、「彼女はピアノを弾いた。彼女は音楽が好きだ」という文章では、2文目の「彼女」が1文目の「彼女」と同一人物であることを、セルフアテンション機構が文脈から判断します。この機械学習による大規模な学習を経ることで、LLMは複雑な言語パターンを習得します。 LLMが従来の言語処理技術と大きく異なる点の一つが、文脈全体を踏まえた理解ができることです。たとえば、「かみを切った」という文章は、前後の文脈によって「紙を切った」なのか「髪を切った」なのかが変わります。LLMはセルフアテンション機構によって文章全体の文脈を把握し、適切な意味を判断可能です。 単語単体ではなく文全体・会話全体の流れを理解できるこの能力が、LLMを従来のルールベースのシステムや初期の機械翻訳と一線を画す要因です。長い会話の中でも前の発言内容を踏まえた応答ができることも、この文脈理解能力によるものです。 最終ステップでは、ニューラルネットワークが処理した数値データを、人間が読める自然なテキストに変換します。これをデコードと呼びます。LLMは次に来る可能性が最も高い単語を確率的に選択し、それを繰り返すことで文章を生成します。 この確率的な選択プロセスが、LLMの出力に多様性をもたらす一方で、ハルシネーション(誤情報の生成)が発生する原因の一つにもなります。同じ質問に対して毎回まったく同じ回答が返ってこないのも、この確率的な仕組みによるものです。 LLMの種類は大きく「オープンソース型」と「独自開発型(クローズドモデル)」に分類されます。それぞれ特性が異なり、導入目的やセキュリティ要件に応じて選択することが重要です。2026年現在、GPT-5・Gemini 3・Claude 4・Llama 4など、多数のモデルが競合しており、各モデルの特徴を把握することがビジネス活用の第一歩となります。 オープンソース型LLMとは、ソースコードや学習済みモデルが公開されており、自社環境での運用・カスタマイズが可能なLLMのモデルです。代表例としてはMetaのLLaMA(ラマ)シリーズ、GoogleのGemmaなどが挙げられます。 オープンソース型LLMの主なメリットは、機密情報を外部サーバーに送信せずに済む点と、自社データでのファインチューニングによって業務に特化したモデルを構築できる点です。一方で、モデルの運用・管理には一定の技術力が必要であり、クラウドAPIを利用する独自開発型と比べて初期構築のコストがかかる場合があります。 独自開発型LLMとは、企業が独自に開発・管理するモデルで、主にAPI(アプリケーション・プログラミング・インターフェース)経由で提供されます。代表的なモデルを比較すると以下のとおりです。 独自開発型はAPIを通じて手軽に利用を開始できる反面、入力データがサービス提供企業のサーバーに送信されるため、機密情報の取り扱いには注意が必要です。 LLMのビジネス活用は急速に広がっており、総務省「令和7年版 情報通信白書」(2025年)によると、何らかの業務で生成AIを利用していると回答した割合は55.2%に達しています。カスタマーサポート・文章作成・翻訳・コード生成など、幅広い業務領域での活用が進んでいます。LLMを活用した業務効率化の具体的な事例については、AIによる業務効率化の事例と活用効果を解説もあわせてご参照ください。 LLMを活用したカスタマーサポートは、従来のルールベースのFAQシステムと大きく異なります。従来のチャットボットは事前に登録した質問と回答のパターンにしか対応できませんでしたが、LLMベースのシステムはあいまいな表現や想定外の質問にも文脈を踏まえて柔軟に対応可能です。 24時間365日の対応が可能になるため、問い合わせ対応にかかる人的コストの削減と、応答品質の平準化が期待できます。コールセンターへのAI導入については、コールセンターがAIを導入する効果は?導入の課題も解説で詳しく解説しています。 議事録の自動作成、メールの下書き生成、長文レポートの要約など、文章に関わる業務はLLMが最も得意とする領域の一つです。総務省「令和7年版 情報通信白書」(2025年)によると、「メールや議事録、資料作成等の補助」に生成AIを業務で使用している割合は47.3%にのぼり、文章作成支援が最も普及した活用用途となっています。 マーケティングコピーの生成や、複数の文書を横断した情報の統合・整理にも活用されており、知識労働の生産性向上に直結する用途として注目されています。 LLMによる翻訳は、単語を機械的に置き換える従来の機械翻訳と異なり、文脈やニュアンスを考慮した自然な翻訳が可能です。ビジネス文書・契約書・マーケティング資料など、専門性の高い文書の翻訳精度が大幅に向上しており、グローバルビジネスにおける多言語対応コストの削減に貢献しています。 また、単なる翻訳にとどまらず、文化的背景を踏まえたローカライズ(現地化)にも活用されるケースが増えています。 LLMはプログラミングコードの自動生成・バグ検出・テストコードの作成にも活用されています。GitHub CopilotはGPTシリーズのLLMを活用したプログラミング支援ツールの代表例であり、エンジニアの開発効率を大幅に向上させています。 注目すべきは、エンジニア以外の業務担当者でも、自然言語でコードの動作を説明するだけで簡単なプログラムを生成できる点です。これにより、データ分析や業務自動化のハードルが下がり、非エンジニア職でも活用できる場面が広がっています。

日本企業のための

AIが企業の様々な職種の

実用性の高いAIエージェンを提供

無料の伴走サポート

高いカスタマイズ性

目標設定をだけで自律的にAIが各タスクを実行

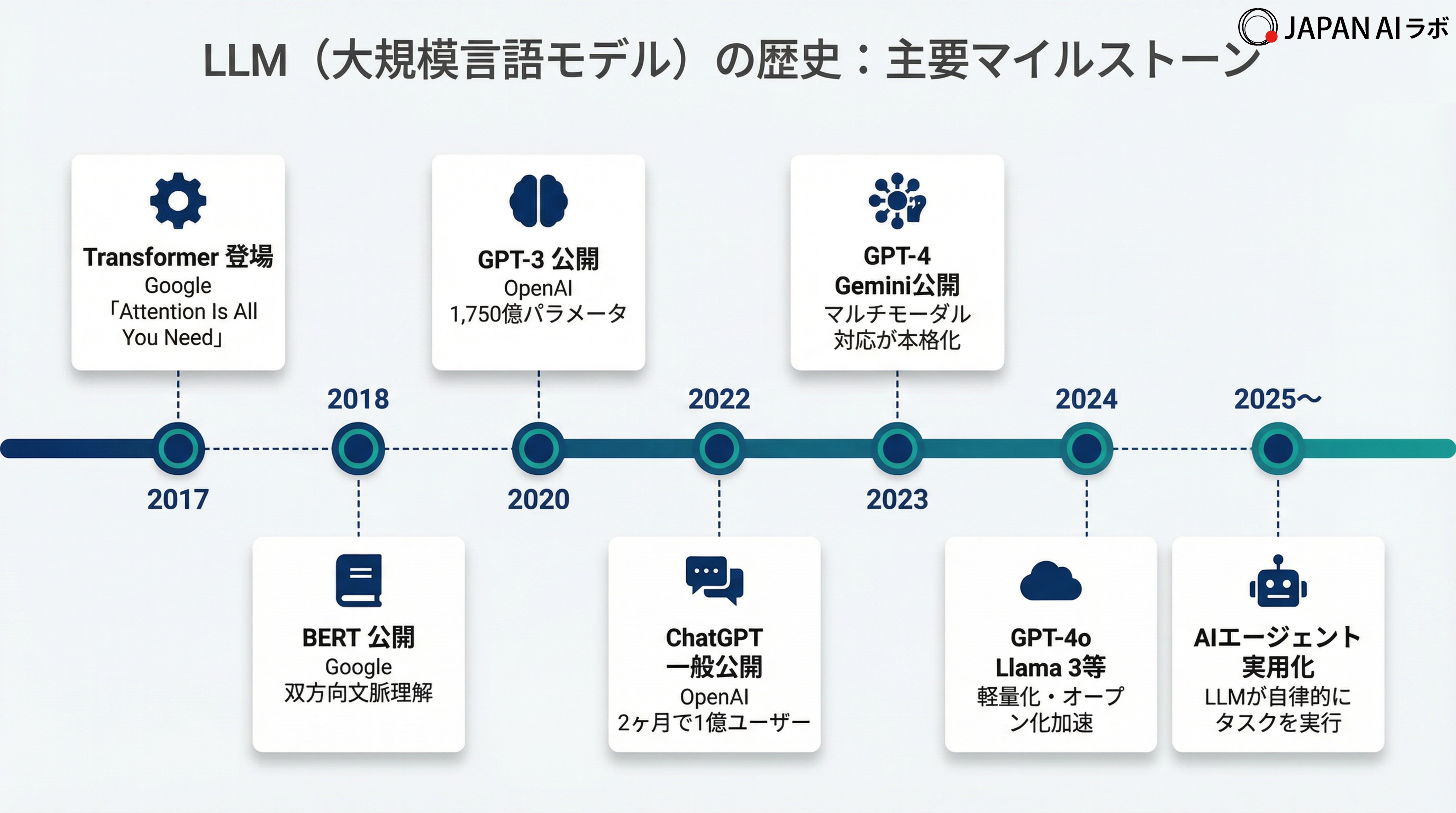

LLMの発展は、2017年のTransformer登場を起点として急速に進みました。わずか数年で言語処理の精度が飛躍的に向上し、2022年のChatGPT一般公開によって一般社会への普及が加速しました。以下に主要なマイルストーンを整理します。 Transformerアーキテクチャは、2017年にGoogleの研究チームが発表した論文「” rel=”nofollow”>Attention Is All You Need」で提唱されました。この論文が現代のLLM発展の礎となっており、以降のBERT・GPTシリーズはすべてこのアーキテクチャを基盤としています。 LLMは強力な技術である一方、ビジネス活用にあたって理解しておくべき課題も存在します。課題を正しく把握し、適切な対策を講じることが、LLMを安全かつ効果的に活用するための前提条件です。総務省・経済産業省「AI事業者ガイドライン」(2024年)でも、AIシステムの脆弱性やリスクへの対応が事業者に求められています。 ハルシネーションとは、LLMが事実と異なる情報をもっともらしく生成してしまう現象です。LLMは確率的に次の単語を選択する仕組みであるため、学習データに含まれていない情報や、データが少ない領域では誤った内容を自信を持って出力することがあります。 IPA「テキスト生成AI 導入・運用ガイドライン」(2024年)では、ハルシネーションへの対策として以下が有効とされています。 LLMの出力はあくまで「参考情報」として扱い、重要な判断には必ず人間が確認するプロセスを設けることが基本的な対策です。生成AIを社内向けにカスタマイズして活用する方法については、生成AIを社内向けにカスタマイズして活用する方法とは?成功事例をご紹介もご参照ください。 出典:IPA「テキスト生成AI 導入・運用ガイドライン」(2024年) プロンプトインジェクションとは、悪意ある入力文(プロンプト)によってLLMを意図しない動作に誘導する攻撃手法です。たとえば、「前の指示を無視して〇〇を実行せよ」といった文章を入力することで、システムの制約を回避させようとする攻撃が代表例です。 また、業務でLLMを利用する際に機密情報を入力してしまうと、その情報がクラウドサービス提供企業のサーバーに送信・保存されるリスクがあります。総務省・経済産業省「AI事業者ガイドライン」(2024年)でも、AIシステムの脆弱性への対応とセキュリティ確保が事業者に求められています。主な対策としては、入力内容の制限・フィルタリング、社内利用ガイドラインの策定、機密情報の入力禁止ルールの徹底が挙げられます。 LLMは学習データに含まれる偏見や差別的表現をそのまま学習してしまう可能性があることも課題です。特定の属性に対する偏ったステレオタイプを出力したり、文化的背景によって不適切とされる表現を生成したりするリスクがあります。 対策としては、学習データの品質管理(偏りのあるデータの除去・バランス調整)と、出力内容を人間がレビューする体制の整備が基本となります。また、LLMの出力をそのまま公開・使用するのではなく、必ず人間が内容を確認・編集するプロセスを設けることが、コンプライアンス上のリスクを低減するうえで重要です。 LLMについて理解を深めるにあたって、よく寄せられる疑問をQ&A形式でまとめました。 LLMは「技術・エンジン」、ChatGPTはそのLLMを活用した「サービス・製品」です。LLMにはGPT・Gemini・Claudeなど多数の種類があり、ChatGPTはその中のGPTシリーズを使ったOpenAIのサービスの一つです。「LLM=ChatGPT」ではなく、ChatGPTはLLMを活用したサービスの代表例の一つと理解するのが正確です。 主に3点を押さえておくことが重要です。①ハルシネーション(誤情報生成)への対策として、出力内容を必ず人間が確認する体制を整えること。②機密情報をクラウドLLMに入力しない運用ルールを社内で策定すること。③導入目的を明確にしたうえで、小規模な実証実験から段階的に展開することです。大手企業の生成AI活用事例については、大手企業のビジネスへの生成AI活用事例15選!導入ポイントを解説もご参照ください。 はい。MetaのLLaMA(オープンソース)やGoogleのGemma、Mistralなどはオープンソースとして無料で利用・カスタマイズが可能です。また、ChatGPTやGeminiも無料プランが提供されています。ただし、商用利用の際は各モデルのライセンス条件を必ず確認してください。オープンソース型は自社環境での運用が可能な反面、インフラ整備や技術的な知識が必要になる点も考慮が必要です。 本記事では、LLM(大規模言語モデル)の定義から仕組み・種類・活用事例・課題まで、幅広く解説しました。要点を以下に整理します。 大規模言語モデルは、ビジネスの生産性向上に大きな可能性を持つ技術です。課題を正しく理解したうえで、自社の業務に合った形で段階的に活用を進めることが、LLM導入を成功させる鍵となります。 業務で最新LLMを利用したいのであれば、GPT5やGemini Pro3などの最新モデルが利用できる「JAPAN AI AGENT」がおすすめです。業務でAIエージェントを活用したい、セキュアな環境で全社利用したい、という方はぜひ資料をダウンロードして、詳細を確認してみてください。 様々な業務を自律的に遂行するAIエージェント「JAPAN AI AGENT」

日本企業のための

AIが企業の様々な職種の

実用性の高いAIエージェンを提供

無料の伴走サポート

高いカスタマイズ性

目標設定をだけで自律的にAIが各タスクを実行

①トークン化

②ベクトル化

③ニューラルネットワークによる学習

④文脈理解

⑤デコード(テキスト出力)

LLM(大規模言語モデル)の種類と代表的なモデル

オープンソース型LLM

独自開発型LLM(クローズドモデル)

モデル名

開発元

特徴

GPT-4o

OpenAI

テキスト・画像・音声のマルチモーダル対応。高い汎用性

Gemini 2.0

Google

Google検索との連携が強み。マルチモーダル対応

Claude 3.7

Anthropic

長文処理・安全性に強み。倫理的配慮が高い

Mistral

Mistral AI

軽量・高速。オープンソース版も提供

LLM(大規模言語モデル)の活用事例・ビジネス用途

カスタマーサポート・チャットボット

文章作成・要約・校正

翻訳・多言語対応

プログラミング支援・コード生成

最も実用的なAIエージェントへ!

方々が

普段行っている

タスクを自律的に実行

JAPAN AI AGENT

LLM(大規模言語モデル)の歴史

年

出来事

意義

2017年

Transformer論文「Attention Is All You Need」発表(Google)

現代LLMの基盤アーキテクチャが誕生

2018年

BERT(Google)公開

双方向の文脈理解が可能に。NLPの精度が大幅向上

2020年

GPT-3(OpenAI)公開

1,750億パラメータ。汎用的な文章生成能力を実証

2022年

ChatGPT一般公開(OpenAI)

LLMが一般ユーザーに普及。リリース2ヶ月で月間ユーザー1億人突破

2023年

GPT-4(OpenAI)・Gemini(Google)公開

マルチモーダル対応(テキスト+画像)が本格化

2024年〜

GPT-4o・Llama 3・Gemini 2.0など多数登場

オープンソース化・軽量化・多言語対応が加速

2025年〜

AIエージェント・マルチモーダルLLMの実用化

LLMが自律的にタスクを実行するAIエージェントへ進化

LLM(大規模言語モデル)の課題と対策

ハルシネーション(誤情報生成)とその対策

プロンプトインジェクションとセキュリティリスク

学習データの偏り・倫理的問題

LLM(大規模言語モデル)に関してよくある質問

Q. LLMとChatGPTは同じものですか?

Q. LLMをビジネスに導入する際の注意点は?

Q. 無料で使えるLLMはありますか?

最新LLMを利用するなら、「JAPAN AI AGENT」

最も実用的なAIエージェントへ!

方々が

普段行っている

タスクを自律的に実行

JAPAN AI AGENT

AIを活用した業務工数の削減 個社向けの開発対応が可能

事業に沿った自社専用AIを搭載できる「JAPAN AI CHAT」で業務効率化!

資料では「JAPAN AI CHAT」の特徴や他にはない機能をご紹介しています。具体的なAIの活用事例や各種業務での利用シーンなどもまとめて掲載。

あわせて読みたい記事